Hallo,

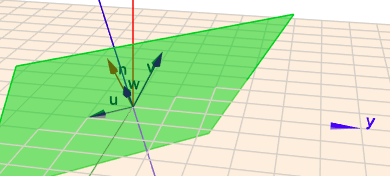

Sind die Spaltenvektoren von \(A\) \(u\), \(v\) und \(w\), so sit hier: \(w = (u+v)/2\). Die Spaltenvektoren sind also linear von einander abhängig. Das Bild von \(A\) ist folglich eine Ebene, die von zwei der drei Spaltenvektoren aufgespannt wird. So ist das Bild \(B\):$$B= \left\{x \in \mathbb R^3: \space n x = 0, \space n= k(u \times v), \space k \in \mathbb R \implies \begin{pmatrix}-1\\ -1\\ 1\end{pmatrix} x = 0 \right\}$$Und der Kern \(K\) von \(A\) ist die Menge aller \(x \in \mathbb R^3\), für die gilt:$$K = \left\{ x \in \mathbb R^3: A \cdot x = 0 \implies x = \begin{pmatrix}1\\ 1\\ -2\end{pmatrix} t, \space t \in \mathbb R\right\}$$Hier sind das Bild (die grüne Ebene) und der Kern (die blaue Gerade) im Bild dargestellt:

(klick auf das Bild)

Die Projektionsmatrix \(P\) auf eine Ursprungsebene mit Normalenvektor \(n\) (s.o. und rot im Bild) ist:$$ P = \underline 1 - \frac{n \cdot n^T}{\left< n, n\right>} = \frac 13 \begin{pmatrix}2& -1& 1\\ -1& 2& 1\\ 1& 1& 2\end{pmatrix}$$Somit gilt für jedes \(x \in \mathbb R^3\)$$x' = P \cdot x, \space x' \in B \space \land \space x-x' = k n, \space k \in \mathbb R$$

(b) da der Kern ein 1-dimensionaler Vektorraum ist, besteht seine Orthonormalbasis \(B_K\) nur aus einem Vektor der Länge 1$$B_K = \left\{ \frac 1{\sqrt 6 } \begin{pmatrix}1\\ 1\\ -2\end{pmatrix}\right\}$$(s.o.)

(c) die Pseudoinverse \(A^+\) - genauer die Moore-Penrose-Inverse - berechnet sich nach dem Verfahren, was hier beschrieben ist. Die Matrizen \(B\) und \(C\) beziehen sich auf das dort beschrieben Verfahren, nach dem \(A = B \cdot C\) gilt. Ich habe:$$\begin{aligned} B &= \begin{pmatrix}1& 1\\ -1& 1\\ 0& 2\end{pmatrix}, \quad C = \begin{pmatrix}1& 0& 0,5\\ 0& 1& 0,5\end{pmatrix}\\ A^+ &= C^T \cdot (CC^T)^{-1} \cdot (B^TB)^{-1} \cdot B^T\\ &= \frac 1{18} \begin{pmatrix}7& -8& -1\\ 1& 4& 5\\ 4& -2& 2\end{pmatrix} \end{aligned}$$Falls Du Fragen dazu hast, so melde Dich bitte.