Thema: Konvex/konkav, Konvexität, Optimierung, Optimierungsaufgabe, Mathematische optimierung

Ich studiere Electronic Engineering. Und als Vertiefungs nun lerne ich convex optimization bzw. wirless communication system.

Leider habe ich echt viele Probleme in diesen Hausaufgaben. Es wäre echt super, wenn Sie mir hilfen könnten.

Die Frage sind relativ viel... 5 Aufgaben. Dafür entschuldige ich mich. Trotzdem brauche ich unbedingt Ihre Hilfe.

Danke für Ihre Bemühung

Text erkannt:

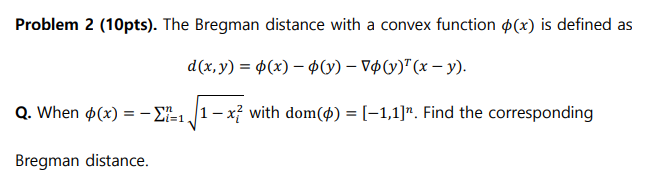

Problem 2 (10pts). The Bregman distance with a convex function \( \phi(x) \) is defined as

$$ d(x, y)=\phi(x)-\phi(y)-\nabla \phi(y)^{T}(x-y) . $$

Q. When \( \phi(x)=-\sum \limits_{i=1}^{n} \sqrt{1-x_{i}^{2}} \) with \( \operatorname{dom}(\phi)=[-1,1]^{n} \). Find the corresponding

Bregman distance.

Text erkannt:

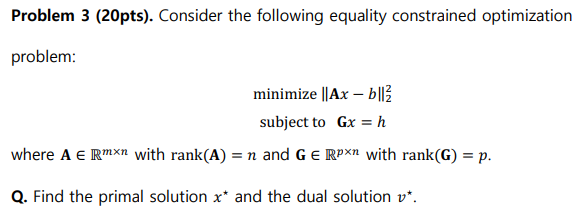

Problem 3 (20pts). Consider the following equality constrained optimization

problem:

$$ \operatorname{minimize}\|\mathbf{A} x-b\|_{2}^{2} $$

subject to \( \mathbf{G} x=h \)

where \( \mathbf{A} \in \mathbb{R}^{m \times n} \) with \( \operatorname{rank}(\mathbf{A})=n \) and \( \mathbf{G} \in \mathbb{R}^{p \times n} \) with \( \operatorname{rank}(\mathbf{G})=p \).

Q. Find the primal solution \( x^{\star} \) and the dual solution \( v^{\star} \).

Text erkannt:

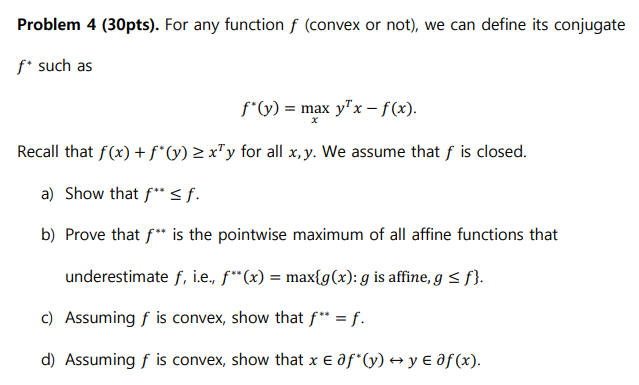

Problem 4 (30pts). For any function \( f \) (convex or not), we can define its conjugate

\( f^{*} \) such as

$$ f^{*}(y)=\max _{x} y^{T} x-f(x) $$

Recall that \( f(x)+f^{*}(y) \geq x^{T} y \) for all \( x, y . \) We assume that \( f \) is closed.

a) Show that \( f^{* *} \leq f \).

b) Prove that \( f^{* *} \) is the pointwise maximum of all affine functions that

underestimate \( f \), i.e., \( f^{* *}(x)=\max \{g(x): g \) is affine, \( g \leq f\} \).

c) Assuming \( f \) is convex, show that \( f^{* *}=f \).

d) Assuming \( f \) is convex, show that \( x \in \partial f^{*}(y) \leftrightarrow y \in \partial f(x) \).

Text erkannt:

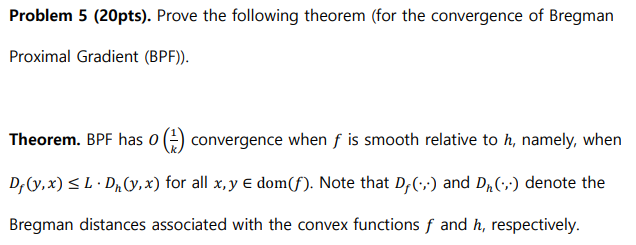

Problem 5 (20pts). Prove the following theorem (for the convergence of Bregman

Proximal Gradient (BPF)).

Theorem. BPF has \( O\left(\frac{1}{k}\right) \) convergence when \( f \) is smooth relative to \( h \), namely, when

\( D_{f}(y, x) \leq L \cdot D_{h}(y, x) \) for all \( x, y \in \operatorname{dom}(f) \). Note that \( D_{f}(\because) \) and \( D_{h}(\because) \) denote the

Bregman distances associated with the convex functions \( f \) and \( h \), respectively.